Der "Daten-Hunger" im digitalen Zeitalter – Eine Einleitung

Du weißt, dass die Daten, die du für deinen Erfolg brauchst, irgendwo da draußen im öffentlichen Web frei verfügbar sind: die Preise deiner gesamten Konkurrenz, Tausende von potenziellen Leads auf LinkedIn oder Google Maps, Produktinformationen von Lieferanten-Websites oder die neuesten Kundenbewertungen von Amazon. Aber der Versuch, diese geschäftskritischen Daten manuell zu sammeln, ist eine schier unmögliche Sisyphusarbeit – fehleranfällig, langsam und extrem teuer.

Selbst wenn du technisch versiert bist und versuchst, eigene Skripte zu schreiben, beginnt der eigentliche Albtraum erst: Websites ändern ständig ihr Layout, aggressive Anti-Bot-Maßnahmen blockieren dich nach wenigen Anfragen, und du musst dich mit einem undurchsichtigen Dschungel aus Proxies, Browser-Fingerprinting und CAPTCHA-Lösungen herumschlagen. Deine Skripte brechen ständig und die Daten sind unzuverlässig.

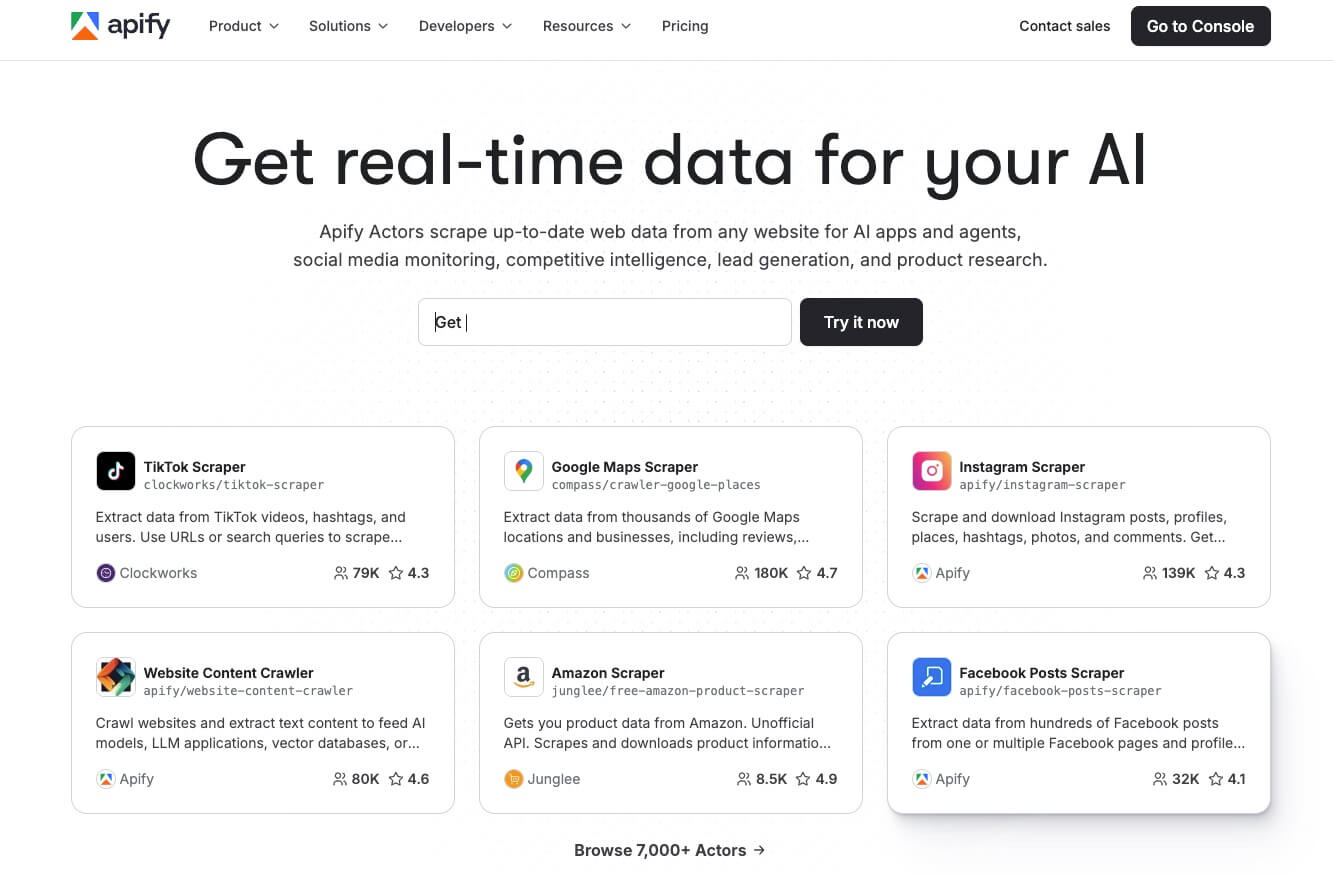

Was aber, wenn du eine professionelle Plattform hättest, die dir all diese technischen Kopfschmerzen abnimmt? Was wäre, wenn du auf eine riesige Bibliothek von über 6.000 vorgefertigten, ständig gewarteten "Scrapern" zugreifen oder deine eigenen, unbegrenzt skalierbaren Automatisierungen in der Cloud bauen könntest? Genau das ist das Versprechen von Apify. Es ist keine simple Browser-Extension, sondern eine professionelle Full-Stack-Plattform für Datenextraktion und Web-Automatisierung. Aber ist es das richtige Werkzeug für dich, oder zu komplex für deine Zwecke? Wir haben es für dich im Detail analysiert.

Was ist Apify eigentlich? (Die große Einordnung)

Um es klar zu sagen: Apify ist weit mehr als nur ein "Web Scraper". Es ist eine umfassende Cloud-Plattform für Automatisierung, auf der du eigenständige Programme, sogenannte "Actors", laufen lässt, die jede erdenkliche Aufgabe im Web für dich erledigen können. Das reine Extrahieren von Daten (Scraping) ist dabei nur eine von vielen Möglichkeiten.

Das Herzstück von Apify ist das sogenannte "Actor"-Framework. Ein Actor ist im Grunde ein wiederverwendbares, in der Cloud laufendes Skript, das du einfach mit deinen Parametern fütterst (z.B. "suche nach 'Friseure in Berlin' auf Google Maps") und dann auf Knopfdruck oder nach einem Zeitplan startest. Es arbeitet völlig autonom und liefert dir am Ende die sauberen, strukturierten Daten.

Der wohl größte Vorteil für die meisten Nutzer ist der Apify Store – der "App Store" für Scraper. Anstatt das Rad neu erfinden zu müssen, kannst du auf einen Marktplatz mit Tausenden von fertigen und professionell gewarteten Actors für fast jede populäre Website zugreifen. Ob Google Maps, Instagram, Amazon, TikTok oder Branchenverzeichnisse – die Wahrscheinlichkeit ist hoch, dass es für deine Datenquelle bereits einen fertigen Actor gibt. Das senkt die Einstiegshürde dramatisch und macht die Power von Web Scraping auch für Nicht-Entwickler zugänglich.

Hör auf, Daten manuell zu kopieren!

Erschließe das volle Potenzial des Webs als deine persönliche Datenquelle. Finde im Apify Store fertige Lösungen für deine Datenerfassung oder baue deine eigenen, skalierbaren Automatisierungen.

Die wichtigsten Funktionen und Technologien im Praxistest

Apify ist eine Plattform, die von Entwicklern für Entwickler gebaut wurde, aber auch für technisch versierte Marketer zugänglich ist. Wir haben die Kernkomponenten getestet, die Apify so leistungsstark machen.

Der Apify Store in Aktion (Dein Sofort-Start)

Um die Plattform zu testen, haben wir einen der populärsten Actors ausprobiert: den "Google Maps Scraper". Die Konfiguration war erstaunlich einfach. Wir mussten lediglich definieren, wonach wir suchen ("Steuerberater in Hamburg") und wie viele Ergebnisse wir haben wollten. Nach dem Start arbeitete der Actor im Hintergrund und lieferte uns nach wenigen Minuten eine perfekt strukturierte Excel-Tabelle mit Namen, Adressen, Telefonnummern, Website-URLs und sogar den Bewertungen der gefundenen Unternehmen. Die Qualität der Daten war exzellent und sofort einsatzbereit für eine Lead-Liste. Diesen Prozess manuell durchzuführen, hätte Stunden gedauert.

Das Anti-Detection-Arsenal (Der Tarnkappen-Modus)

Warum ist Apify so viel zuverlässiger als einfache, selbstgeschriebene Skripte? Weil es eine ganze Reihe von ausgeklügelten Technologien zur Umgehung von Anti-Bot-Maßnahmen standardmäßig integriert hat. Dazu gehören:

- Proxy-Rotation: Apify betreibt einen riesigen Pool von Datacenter- und Residential-IP-Adressen. Bei jeder Anfrage an eine Website wird die IP-Adresse automatisch gewechselt, sodass es für die Zielseite so aussieht, als kämen die Anfragen von tausenden verschiedenen Nutzern. Das verhindert IP-Blockaden effektiv.

- Browser-Fingerprinting: Die Plattform imitiert die einzigartigen Eigenschaften echter Browser und Nutzer, was es für Schutzmechanismen extrem schwer macht, die automatisierten Anfragen als Bots zu identifizieren.

- Intelligente CAPTCHA-Lösung: Wenn der Actor auf eine "Ich bin kein Roboter"-Abfrage stößt, werden diese im Hintergrund automatisch durch integrierte Dienste gelöst, ohne den Scraping-Prozess zu unterbrechen.

Eigene Actors entwickeln (Für die Profis)

Während der Apify Store der perfekte Einstieg für die meisten Nutzer ist, liegt die wahre, unbegrenzte Power der Plattform in der Möglichkeit, komplett eigene Automatisierungen zu entwickeln. Für Entwickler ist Apify ein Paradies. Mit dem Open-Source-Framework Crawlee und den offiziellen SDKs für JavaScript und Python kannst du praktisch jede erdenkliche Aufgabe im Web automatisieren. Du bist nicht auf die vorgefertigten Lösungen beschränkt, sondern kannst deine eigene Logik implementieren, um hochkomplexe Datenextraktionen oder Prozessautomatisierungen zu realisieren. Die Entwicklung, das Testen und das Deployment deiner eigenen Actors wird durch die Apify-Infrastruktur massiv vereinfacht.

Integrationen & Workflow-Automatisierung (Die Daten zum Leben erwecken)

Extrahierte Daten sind nutzlos, wenn sie nur in einer Tabelle liegen. Apify macht es dir extrem einfach, deine Daten in die Tools zu bringen, die du bereits nutzt. Über native Integrationen mit Zapier, Make (ehemals Integromat) oder einfachen Webhooks kannst du nahtlose Automatisierungsketten bauen. Ein typischer Workflow könnte so aussehen:

- Ein Apify Actor scraped stündlich die neuesten Produktpreise deiner Konkurrenz.

- Sobald der Actor fertig ist, wird automatisch ein Zapier-Workflow ausgelöst.

- Die neuen Daten werden in eine Google-Sheet-Tabelle geschrieben.

- Wenn ein Preis unter einen bestimmten Schwellenwert fällt, wird automatisch eine Benachrichtigung an dein Team in Slack gesendet.

So werden aus rohen Daten automatisierte, geschäftskritische Prozesse.

Finde deinen persönlichen Daten-Roboter

Durchsuche den Apify Store nach über 6.000 vorgefertigten Scrapern und Automatisierungen. Die Wahrscheinlichkeit ist hoch, dass es für dein Problem bereits eine fertige Lösung gibt, die du sofort starten kannst.

Für wen ist Apify ein absoluter Game-Changer?

Apify ist kein simples Tool für jedermann, sondern eine professionelle Plattform für Nutzer mit klaren Zielen. Nach unserem Test ist es eine überragende Wahl für folgende Gruppen:

Das ist DEIN Tool, wenn...

- ... du ein Entwickler oder Data Scientist bist und eine robuste, skalierbare und zuverlässige Infrastruktur für deine Web-Scraping- und Automatisierungsprojekte suchst. Apify nimmt dir die ganze Drecksarbeit (Proxy-Management, Skalierung etc.) ab.

- ... du als technisch versierter Marketer oder Gründer systematisch auf Wettbewerbsdaten, Lead-Listen oder Marktdaten zugreifen musst und bereit bist, dich in ein mächtiges Tool einzuarbeiten. Der Apify Store ist deine Goldgrube.

- ... dein Unternehmen Daten zur Fütterung von KI-Modellen benötigt. Apify ist perfekt geeignet, um aktuelle, strukturierte Daten aus dem Web zu extrahieren, um damit Large Language Models (LLMs) über RAG-Pipelines mit relevantem Wissen zu versorgen.

Lass lieber die Finger davon, wenn...

- ... du eine einfache "One-Click"-Lösung suchst, bei der du nichts konfigurieren musst. Obwohl der Apify Store vieles vereinfacht, erfordert die Plattform immer eine gewisse Einarbeitung.

- ... du keinerlei technisches Grundverständnis hast und dich schon Konzepte wie "CSV-Export" oder "API" abschrecken.

- ... du nur einmalig ein paar wenige Daten von einer einzigen, ungeschützten Website extrahieren musst. Hierfür gibt es einfachere, kostenlose Browser-Extensions.

Video-Einblick: Apify in Aktion

Die Power von Apify liegt in der Kombination aus fertigen Scrapern und der Möglichkeit, eigene zu bauen. Um dir ein noch besseres Gefühl für die Plattform zu geben, haben wir dieses offizielle Video herausgesucht. Es gibt dir einen hervorragenden Einblick und zeigt, wie ein typischer Workflow aussieht, um eine beliebige Website zu scrapen:

Das Preismodell: Was kosten die Daten?

Apify nutzt ein flexibles "Pay-as-you-go"-Modell. Du zahlst nicht pro Scraper, sondern für die tatsächlich genutzte Rechenleistung. Die Währung dafür sind die sogenannten "Compute Units" (CUs). Eine CU entspricht dabei 1 GB Arbeitsspeicher, der für eine Stunde genutzt wird.

Die monatlichen Abo-Pläne (Free, Starter, Scale etc.) beinhalten ein bestimmtes Kontingent an "Prepaid"-Nutzungs-Credits. Deine monatliche Gebühr wird also in Guthaben umgewandelt, das du auf der Plattform ausgeben kannst. Der Clou: Je höher dein Plan, desto günstiger wird der Preis pro einzelner Compute Unit. Das belohnt eine intensive Nutzung.

Ein Praxisbeispiel: Das Scrapen von 10.000 Produkten von der E-Commerce-Seite eines Konkurrenten könnte einige CUs verbrauchen. Im Starter-Plan würde dich das vielleicht wenige Dollar kosten. Die genauen Kosten hängen aber stark von der Komplexität der Ziel-Website und der Effizienz des Scrapers ab. Das Tolle ist der kostenlose Plan: Du bekommst jeden Monat 5$ an Credits geschenkt, um Actors risikofrei zu testen und ein Gefühl für die Kosten zu bekommen.

Finde deinen persönlichen Daten-Roboter

Durchsuche den Apify Store nach über 6.000 vorgefertigten Scrapern und Automatisierungen. Die Wahrscheinlichkeit ist hoch, dass es für dein Problem bereits eine fertige Lösung gibt, die du sofort starten kannst.

Was wir cool finden (Die Stärken) & Wo es hakt (Die Schwächen)

Die Stärken (Was uns überzeugt hat)

- ✅ Die riesige Auswahl im Apify Store: Das ist ein gewaltiger Vorteil. Die Wahrscheinlichkeit, eine fertige Lösung für dein Problem zu finden, ist extrem hoch und senkt die Einstiegshürde dramatisch.

- ✅ Extrem robuste Anti-Detection-Technologie: Apifys integriertes Proxy- und Browser-Management ist absolute Weltklasse. Es funktioniert einfach und erspart dir unzählige Stunden Frustration.

- ✅ Skalierbarkeit für riesige Datenmengen: Egal ob du 100 Datenpunkte oder 100 Millionen brauchst – die Plattform skaliert mit deinen Anforderungen, ohne dass du dich um die Infrastruktur kümmern musst.

- ✅ Flexibilität für Entwickler: Für Profis bieten das Open-Source-Framework Crawlee und die SDKs unbegrenzte Möglichkeiten, die weit über die fertigen Actors hinausgehen.

Die Schwächen (Was du wissen solltest)

- ❌ Die Lernkurve ist steil für Nicht-Techniker: Trotz des Apify Stores ist die Plattform mächtig und hat viele Optionen. Sie erfordert die Bereitschaft, sich in technische Konzepte einzuarbeiten.

- ❌ Das Preismodell kann anfangs unübersichtlich wirken: Das Konzept der Compute Units und Plattform-Credits ist weniger intuitiv als ein einfacher "Preis pro Ergebnis". Du musst ein paar Testläufe machen, um ein Gefühl für die Kosten zu bekommen.

- ❌ Erfordert Bewusstsein für rechtliche Aspekte: Web Scraping bewegt sich in manchen Ländern und Anwendungsfällen in einer rechtlichen Grauzone. Apify stellt das Werkzeug bereit, du bist aber für die ethische und legale Nutzung der Daten verantwortlich.

Fazit: Der unfaire Vorteil für Datenhungrige?

Nach unserem Test ist das Fazit klar: Apify ist kein einfaches Tool, sondern eine professionelle Infrastruktur. Es ist wie der Unterschied zwischen einem Spaten und einem Bagger. Beides kann graben, aber die Skalierbarkeit, die Power und die Zuverlässigkeit sind unvergleichlich.

Unsere Klartext-Empfehlung:

Für jeden, der Web-Daten systematisch, zuverlässig und in großem Stil für sein Business nutzen will, ist Apify die mit Abstand beste und robusteste Plattform, die wir getestet haben. Es ist die definitive Lösung für Entwickler, Data Scientists und technisch versierte Marketer, die Daten als Wettbewerbsvorteil sehen.

Dein nächster Schritt: Was ist die eine Datenquelle, die dein Business transformieren würde, wenn du unbegrenzten Zugriff darauf hättest? Schau jetzt im Apify Store nach, ob es dafür bereits einen fertigen Scraper gibt.

Häufig gestellte Fragen (FAQ)

Ist Web Scraping mit Apify legal?

Das Scrapen von öffentlich zugänglichen Daten ist in den meisten Rechtsprechungen, inklusive der EU und den USA, grundsätzlich legal. Du musst jedoch darauf achten, keine personenbezogenen Daten (fällt unter die DSGVO), urheberrechtlich geschützte Inhalte oder Daten hinter einer Login-Schranke zu scrapen. Du bist immer selbst dafür verantwortlich, dass deine Nutzung der Daten mit den lokalen Gesetzen und den Nutzungsbedingungen der Website konform ist.

Was ist der Unterschied zwischen Apify und einfachen Chrome Scraper Extensions?

Browser-Extensions laufen lokal auf deinem Computer, nutzen deine persönliche IP-Adresse und versagen oft bei komplexen Websites oder großen Datenmengen. Apify ist eine Cloud-Plattform, die auf leistungsstarken Servern läuft, tausende von Proxies managt, auf Millionen von Seiten skaliert und nach einem Zeitplan arbeiten kann, ohne dass dein Computer überhaupt eingeschaltet ist.

Muss ich programmieren können, um Apify zu nutzen?

Nicht zwingend. Dank des Apify Stores kannst du viele vorgefertigte "Actors" finden und ausführen, ohne eine Zeile Code zu schreiben. Ein grundlegendes technisches Verständnis für Datenformate (wie CSV oder JSON) und die Funktionsweise von APIs ist aber sehr hilfreich, um das meiste aus der Plattform herauszuholen.

Wie umgeht Apify Blockaden durch Websites?

Apify nutzt eine Kombination aus fortschrittlichen Techniken, darunter einen großen Pool an Datacenter- und Residential-Proxies zur Rotation von IP-Adressen, das Nachahmen von echten Nutzer-Browser-"Fingerprints" und das automatische Lösen von CAPTCHAs im Hintergrund. Das macht die Scraper wesentlich widerstandsfähiger als einfache Skripte.